لفهم مستقبل الذكاء الاصطناعي، ألقِ نظرة على إخفاقات غوغل في الترجمة

لقد تم الاعتراف بعالمي الحاسوب ريتش ساتون وأندرو بارتو بسبب سجلهما الطويل من الأفكار المؤثرة بجائزة تورينغ لهذا العام، وتعدّ الأكثر قيمة في هذا المجال. تُعتبر مقالة ساتون “The Bitter Lesson”عام 2019، على سبيل المثال، أساسًا للكثير من الحماس الحالي حول الذكاء الاصطناعي.

ادعى ساتون بأن طرائق تحسين الذكاء الاصطناعي التي تعتمد على الحوسبة الثقيلة بدلاً من المعرفة البشرية تكون “الأكثر فعالية وبفارق كبير”.

وقد أُثبتت صحة هذه الفكرة عدة مرات في تاريخ الذكاء الاصطناعي. ومع ذلك، هناك درس آخر مهم في ذلك التاريخ يعود إلى حوالي 20 عامًا مضت يجب أن نأخذ به.

تُبنى دردشات الذكاء الاصطناعي اليوم على نماذج اللغة الكبيرة (LLMs)، التي تُدرب على كميات كبيرة من البيانات والتي تُمكن الآلة من “التفكير” من خلال توقع الكلمة التالية في الجملة باستخدام الاحتمالات.

تمت صياغة نماذج اللغة الاحتمالية المفيدة من قبل العالم الأمريكي كلو شانون في عام 1948، مستشهدًا بسوابق من العقدين 1910 و1920.

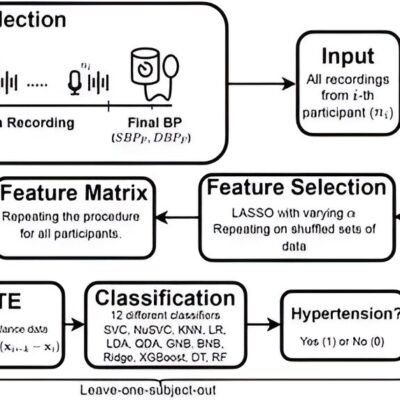

تم تعميم نماذج اللغة من هذا النوع في 1970 و1980 لاستخدامها من قبل الحواسيب في الترجمة والتعرف على الكلام، حيث تم تحويل الكلمات الشفهية إلى نص.

نُشر نموذج اللغة الأول على نطاق نماذج اللغة الكبيرة في عام 2007، كان مكونًا من ترجمة غوغل التي تمّ إطلاقها قبل عام، وتم تدريبه على تريليونات الكلمات باستخدام آلاف الحواسيب، وهو نموذج لا يمكن إنكاره لنماذج اللغة الكبيرة اليوم، على الرغم من أنه كان مختلفًا تقنيًا.

اعتمدت على الاحتمالات المحسوبة من عدد الكلمات بينما تعتمد نماذج اللغة الكبيرة اليوم على ما يُعرف بالتحويلات والتي تم تطويرها لأول مرة في عام 2017- وأيضًا في الأصل للترجمة- وهي شبكات عصبية اصطناعية تجعل من الممكن للآلات استغلال سياق كل كلمة بشكل أفضل.

مزايا ومساوئ ترجمة غوغل

لقد تطورت الترجمة الآلية (MT) في العقديين الماضيين، ليس فقط بالتقدم التكنولوجي ولكن أيضًا بحجم وتنوع مجموعات بيانات التدريب.

بينما بدأت ترجمة غوغل بتقديم الترجمات بين ثلاث لغات في عام 2006-الأنجليزية والصينية والعربية- اليوم تدعم 249 لغة. ومع أن هذا يبدو مثيراً للإعجاب، إلا انه لايزال أقل من 4% من اللغات ال 7000 المقدرة في العالم.

من بين عدد قليل من تلك اللغات، مثل الإنجليزية والإسبانية، تكون الترجمات غالبًا خالية من الأخطاء. ومع ذلك، حتى في هذه اللغات، يفشل المترجم أحيانًا في التعبيرات الاصطلاحية وأسماء الأماكن والمصطلحات القانونية التقنية والعديد من الفروق الدقيقة الأخرى.

بين العديد من اللغات الأخرى، يمكن أن تساعدك الخدمة في فهم مغزى النص، ولكن غالبًا ما تستمر الأخطاء الجدية. أكبر تقييم سنوي لأنظمة الترجمة الآلية -والتي تتضمن الأن الترجمات التي قام بها LLMs والتي تنافس تلك الأنظمة المخصصة للترجمة-بشكل صريح في عام 2024 إلى أن “الترجمة الآلية لم تحل محلها بعد”.

اُستخدمت الترجمة الآلية على نطاق واسع بالرغم من هذه العيوب: منذ عام 2021، وصل تطبيق ترجمة غوغل إلى مليار عملية تثبيت. ومع ذلك، لا يزال يدرك المستخدمون بأن عليهم استخدام هذه الخدمات بحذر. وجدت إحصائية أُجريت في عام 2022 بأن 1200 شخص غالبًا ما استخدموا الترجمة الآلية في بيئات ذات مخاطر منخفضة، مثل فهم المحتوى عبر الانترنت خارج العمل أو الدراسة. فقط 2% من ترجمات المستجيبين تضمن مخاطر أعلى، متضمنةً التفاعل مع العاملين في مجال الرعاية الصحية أو الشرطة.

وبالتأكيد، هناك مخاطر عالية مرتبطة باستخدام الترجمة الآلية في هذه الإعدادات، أظهرت الدراسات بأن أخطاء الترجمة الآلية في مجال الرعاية الصحية يمكن أن تتسبب في ضرر كبير، وهناك تقارير أفادت بأنها أضرت بقضايا اللجوء الموثوقة. ولا يساعد بأن المستخدمون يميلون إلى الوثوق بالترجمة الآلية والتي يسهل فهمها، حتى عندما تكون مضللة.

وبمعرفة المخاطر، تعتمد الترجمة بشكل كبير على المترجمين البشريين في البيئات ذات المخاطر العالية مثل القانون الدولي والتجارة. ومع ذلك، قابلية تسويق هؤلاء العمال انخفضت بسبب حقيقة أن الآلة الآن يمكنها أن تؤدي معظم أعمالهم، مما يجعلهم في موضع أن يركزوا أكثر على ضمان الجودة.

**هل العاملون المستقلون في سوق العمل الوسيط عبر المنصات التي تعتمد على الترجمة الآلية محكوم عليهم بالصراع مع أوضاع هشة؟**.

أصبح العاملون المستقلون، وخاصة المترجمين، يعتمدون بشكل متزايد على منصات العمل التي تستخدم الترجمة الآلية، مما يجبرهم على قضاء وقتهم في **تصحيح مخرجات غير دقيقة** بدلاً من التركيز على العمل الإبداعي. بالإضافة إلى ذلك، يواجهون **عدم الاستقرار الوظيفي والعزلة** المرتبطة بالعمل عبر المنصات، ناهيك عن الخوف الدائم من أن تحل الآلة محلهم تمامًا—وهو ما يُعرف في الأوساط الأكاديمية باسم ** “قلق الأتمتة” **.

الكشف الأخير لنموذج الذكاء الاصطناعي الصيني “Deepseek”، والذي يبدو قريبًا من قدرات النماذج الرائدة في السوق مثل نماذج Gpt ولكن بتكلفة أقل بكثير، إلى أن النماذج اللغوية الكبيرة (LLMs) المتطورة جدًا في طريقها إلى أن تصبح سلعًا، سيتم نشرها من قبل المنظمات من جميع الأحجام بتكلفة أقل – تمامًا كما هو الحال في الترجمة الآلية الأن.

وبالطبع، ذهبت نماذج اللغة الكبيرة بعيدًا عن الترجمة الآلية، حيث تؤدي مهامًا على نطاق أوسع، ولكن محدوديتها الأساسية تكمن في البيانات، حيث استنفذت ما هو متوفر على الانترنت بالفعل، وبالرغم من نطاقها الواسع، من المحتمل بأن تمثل بيانات تدريبها معظم المهام بشكل غير كافٍ تمامًا، كما تمثل بشكل غير كافٍ معظم اللغات في الترجمة الآلية.

بالفعل، المشكلة تزداد سوءًا مع الذكاء الاصطناعي التوليدي: على عكس اللغات، أنه من الصعب معرفة أي المهام تم تمثيلها بشكل جيد في النموذج اللغوي الكبير. لا شك بأن هناك جهودًا لتحسين بيانات التدريب التي تجعل هذه النماذج أفضل في بعض المهام التي تم تمثيلها بشكل ناقص. ولكن نطاق التحدي يتجاوز ما هو موجود في الترجمة الآلية.

قد يعلق المتفائلون في مجال التكنولوجيا آمالهم في إبقاء وزيادة حجم بيانات التدريب من خلال إنشاء نسخ تركيبية خاصة بهم، أو من خلال التعلم من ردود الفعل البشرية خلال تفاعلات الدردشة، هذه الطرق اُكتشفت بالفعل في الترجمة الآلية، مع نجاح محدود.

لذا فأن المستقبل المنظور لنتائج اللغة الكبيرة يكون واحدًا بأنها ممتازة في بعض المهام، متوسطة في أُخرى، غير موثوقة في أماكن أخرى.

سنستخدمها عندما تكون المخاطر منخفضة-بينما يمكنها أن تضُر المستخدمين في بيئات عالية المخاطر كما حدث بالفعل مع محاميين الذين وثقوا في مخرجات ChatGPT التي تستشهد بقوانين غير موجودة.

ستساعد هذه النماذج العمال البشريين في الصناعات التي تتمتع بثقافة ضمان الجودة، مثل برمجة الحواسيب، بينما ستكون تجربة هؤلاء التعامل مع مشاكل جديدة مثل تهديدها للأعمال الفنية البشرية وللبيئة.

والسؤال الملح: هل هذا حقًا هو المستقبل الذي نريد بناءة؟

- ترجمة: نسرين عنتر

- تدقيق علمي ولغوي: حلا سليمان

- المصادر: 1